Dlaczego w ogóle ruszać monolit – perspektywa lidera IT

Kiedy monolit rzeczywiście jest problemem, a kiedy lepiej go nie ruszać

Nie każdy monolit jest zły. Kłopoty zaczynają się wtedy, gdy architektura przestaje nadążać za tempem zmian biznesowych. Jeśli produkt rośnie, rośnie liczba klientów, a czas dostarczania zmian się wydłuża – monolit stopniowo staje się hamulcem. W wielu firmach decyzja o migracji monolitu do mikroserwisów zapada zbyt wcześnie, pod wpływem konferencyjnych historii sukcesu, a nie realnej analizy koszt–korzyść.

Monolitu lepiej nie ruszać, jeśli:

- system jest stabilny, a zakres zmian biznesowych jest niewielki i przewidywalny,

- zespół jest mały (np. do 5–7 deweloperów) i potrafi skutecznie współpracować nad jednym kodem,

- czas wdrożeń i jakość są akceptowalne – zmiany wchodzą na produkcję np. co 2–4 tygodnie bez ciągłych awarii,

- budżet na transformację technologiczną jest ograniczony, a priorytetem są funkcje produktowe.

Z kolei migracja monolitu do mikroserwisów zaczyna mieć sens, gdy:

- każde wdrożenie wymaga koordynacji kilku zespołów i wielodniowego „freeze’u”,

- jeden błąd w mało ważnym module potrafi zablokować release kluczowej funkcji,

- czas od pomysłu do produkcji liczony jest w miesiącach, a konkurencja dostarcza w tygodniach,

- rośnie presja na niezawodność, a monolityczna architektura utrudnia izolowanie awarii.

Lider IT powinien oprzeć decyzję na chłodnej analizie: jeśli problemy da się rozwiązać prostszymi środkami (refaktoryzacja, modularny monolit, automatyzacja testów i wdrożeń monolitu), migracja do mikroserwisów może być zbędnym luksusem. Mikroserwisy są narzędziem do rozwiązywania konkretnych problemów skalowalności organizacyjnej i technicznej – nie celem samym w sobie.

Objawy techniczne i biznesowe wskazujące na konieczność migracji

Monolit zaczyna ciążyć, gdy akumulują się zarówno symptomy techniczne, jak i organizacyjne. W praktyce pojawia się kilka charakterystycznych oznak:

- Długi i nieprzewidywalny cykl wdrożenia – releasy raz na kilka tygodni lub miesięcy, konieczność „okien serwisowych”, duża liczba rollbacków.

- Wysoka zależność między modułami – zmiana w jednym obszarze często psuje inny, pozornie niezwiązany fragment systemu.

- Konflikty między zespołami – kilka zespołów dotyka tych samych fragmentów kodu, rośnie liczba merge konfliktów i blokad.

- Brak skalowalności selektywnej – cały system trzeba skalować poziomo, mimo że tylko część funkcji (np. wyszukiwarka, koszyk) generuje duże obciążenie.

- Rosnący dług technologiczny – każdy sprint kończy się „łataniem” zamiast dostarczaniem realnej wartości biznesowej.

Z perspektywy biznesu objawia się to jako:

- niemożność szybkiego reagowania na zmiany na rynku (np. regulacje, promocje, integracje z partnerami),

- wzrost kosztów utrzymania i częstotliwości incydentów produkcyjnych,

- spadek satysfakcji klientów i użytkowników przez wolne lub niestabilne wdrożenia.

Praktyczny krok dla lidera IT: zebrać wskaźniki takie jak średni czas od commit do produkcji (lead time), częstotliwość wdrożeń, liczba rollbacków, czas przestojów, liczba incydentów związanych z wdrożeniami. To daje twarde dane, zamiast „czucia”, że monolit jest problemem.

Ocena opłacalności: koszt migracji vs koszt pozostania przy monolicie

Migracja monolitu do mikroserwisów z pełnym CI/CD to wielomiesięczny (często wieloletni) projekt. Lider IT potrzebuje prostej kalkulacji, która pokaże: co się stanie, jeśli nic nie zrobimy, i ile jesteśmy gotowi zainwestować w zmianę.

W podstawowej wersji można to rozłożyć na trzy grupy kosztów:

- Koszt obecny – ile teraz kosztują:

- releasy (czas ludzi, liczba incydentów, nadgodziny),

- utrzymanie monolitu (bugfixy vs nowe funkcje),

- blokady biznesu (opóźnione projekty, niewykorzystane szanse).

- Koszt migracji – wysiłek zespołów (etaty, nadgodziny), szkolenia, nowe narzędzia, zwiększone ryzyko incydentów w trakcie transformacji.

- Korzyści po migracji – skrócenie czasu dostarczania, możliwość niezależnych wdrożeń, lepsza skalowalność i odporność na awarie, łatwiejsze delegowanie odpowiedzialności.

Sensowny, „budżetowy” scenariusz zakłada, że część inwestycji w migrację jest pokrywana przez równoległą poprawę obecnego procesu: automatykę testów, CI/CD dla monolitu, lepszą modularność. Dzięki temu zyski pojawiają się stopniowo, a nie dopiero na końcu ogromnego projektu.

Jak sprzedać migrację zarządowi: język korzyści zamiast technologii

Zarząd nie kupuje „mikroserwisów” ani „Kubernetesów”. Kupuje krótszy czas wejścia na rynek, mniejsze ryzyko awarii w krytycznych momentach i przewidywalność kosztów rozwoju. Argumenty techniczne warto przełożyć na 3–4 jasne propozycje biznesowe:

- Szybsze reagowanie na zmiany – możliwość dostarczenia nowych funkcji w tygodnie, nie miesiące.

- Wyższa stabilność systemu – izolowanie awarii, wdrożenia bez przestojów, zmniejszenie liczby krytycznych incydentów.

- Lepsza skalowalność kosztowa – skalowanie tylko tych obszarów, które realnie generują obciążenie i przychód.

- Atrakcyjność dla specjalistów – nowoczesne środowisko pracy ułatwia rekrutację i utrzymanie dobrych inżynierów.

Kluczowe jest zaproponowanie etapowego planu z kontrolą ryzyka, a nie jednego gigantycznego projektu „przepiszmy wszystko”. Zarząd zwykle chętniej zgodzi się na pilotaż i kolejne etapy, jeśli każdy etap ma mierzalny efekt i ograniczone ryzyko.

Mikroserwisy i CI/CD w pigułce – bez marketingu

Co naprawdę oznacza architektura mikroserwisowa

Architektura mikroserwisowa to przede wszystkim niezależność zmian. Każdy mikroserwis odpowiada za wyraźnie wydzieloną domenę biznesową (np. katalog produktów, koszyk, płatności) i może być:

- rozwijany przez dedykowany zespół,

- wdrażany niezależnie od innych,

- skalowany zgodnie z własnymi potrzebami.

Kluczową wartością nie jest liczba serwisów, lecz jasne granice odpowiedzialności. Lepiej mieć kilka dobrze zdefiniowanych serwisów niż dziesiątki pseudo-mikroserwisów silnie zależnych od siebie. Z perspektywy lidera IT migracja monolitu do mikroserwisów jest bardziej projektem organizacyjnym niż czysto technicznym: przestawia strukturę zespołów, odpowiedzialności, procesów decyzyjnych.

Delikatny, ale istotny punkt: mikroserwisy nie są „darmowym skalowaniem”. Każdy nowy serwis to dodatkowy pipeline CI/CD, monitoring, logi, utrzymanie. Korzyści pojawiają się dopiero powyżej pewnej skali złożoności systemu i zespołu.

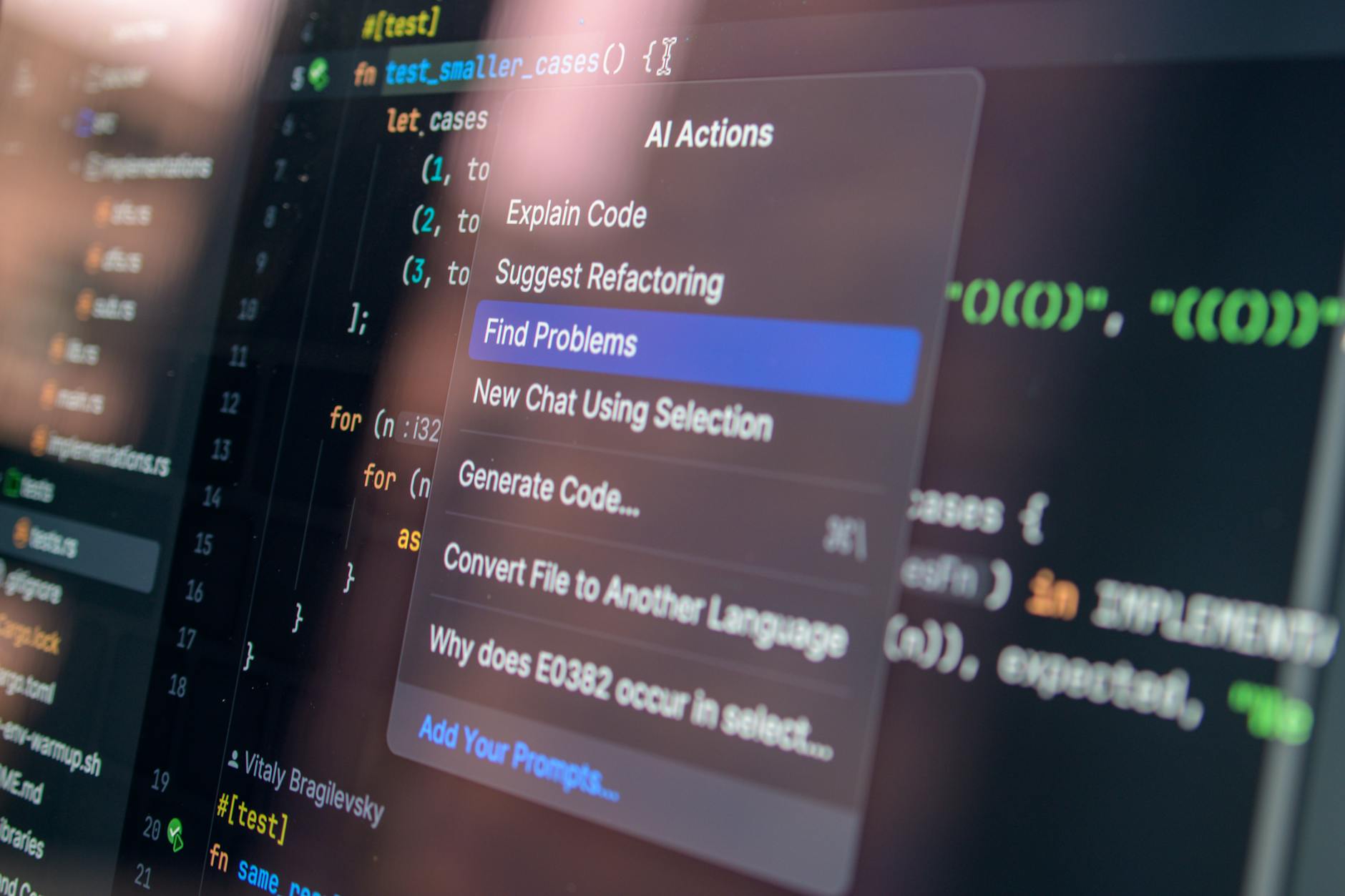

Rola CI/CD: od ręcznych wdrożeń do powtarzalnej automatyzacji

Bez sensownej strategii wdrażania CI/CD architektura mikroserwisowa staje się nie do utrzymania. Przy kilkunastu czy kilkudziesięciu serwisach ręczne klikanie wdrożeń i pół-automatyczne skrypty szybko prowadzą do chaosu. Pipeline CI/CD powinien:

- automatycznie budować artefakt po zmianie w kodzie,

- odpalać zestaw testów (jednostkowych, integracyjnych, kontraktowych),

- pakować aplikację (np. w obraz kontenerowy),

- wdrażać ją na środowiska (test, staging, produkcja) według powtarzalnego schematu,

- dawać szybki feedback, co się zepsuło i gdzie.

Dla lidera IT istotne jest, by standaryzować CI/CD możliwie wcześnie. Każdy mikroserwis z własnym, zupełnie innym sposobem budowania i wdrażania to przepis na wzrost kosztów oraz trudności kadrowe (tylko dwie osoby wiedzą, jak to się wdraża).

Typowe mity wokół mikroserwisów i CI/CD

Wokół migracji monolitu do mikroserwisów narosło sporo mitów, które windowują oczekiwania lub podnoszą koszty bez potrzeby:

- „Mikroserwisy rozwiążą długi technologiczny” – nie rozwiążą. Zły kod przeniesiony w małe serwisy nadal będzie zły, tylko rozproszony. Migrację trzeba połączyć z selektywną refaktoryzacją i porządkowaniem domen.

- „Bez Kubernetes się nie da” – da się. Na start często wystarczy prosty Docker + VM lub managed containers (np. ECS, App Service czy inny PaaS). Kubernetes ma sens przy większej skali, ale też generuje koszt kompetencyjny i operacyjny.

- „Mikroserwisy zawsze są tańsze w utrzymaniu” – nie zawsze. Przy małych systemach i zespołach narzut operacyjny może być wyższy niż korzyści.

- „Musimy mieć super zaawansowane CI/CD od pierwszego dnia” – nie trzeba. Wystarczy dobrze zaprojektowany, ale prosty pipeline, który stopniowo się rozwija.

Rozsądne podejście „budżetowego pragmatyka” polega na tym, żeby:

- zaczynać od prostych narzędzi i wzorców,

- skalować złożoność pipeline’ów cięgle, tylko tam, gdzie daje to mierzalną wartość,

- unikać wdrażania technologii „bo branża tak robi” bez konkretnych argumentów.

Minimalne elementy CI/CD potrzebne przy migracji

Bez pewnego „minimum sanitarnego” w CI/CD migracja monolitu do mikroserwisów nagle przestaje się skalować. Absolutne minimum to:

- System kontroli wersji – Git jako standard, plus jasna strategia branchowania (trunk-based lub prosty GitFlow).

- Runner CI – dowolne narzędzie (GitLab CI, GitHub Actions, Jenkins, Bitbucket Pipelines), byle powtarzalne i wspólne dla wszystkich serwisów.

- Automatyczne buildy i testy – build uruchamiany na każdy merge request / pull request, z szybkim feedbackiem.

- Automatyczne pakowanie – np. obrazy Docker publikowane w centralnym rejestrze.

- Automatyczne wdrożenia na środowiska testowe – żeby każdy merge można było sprawdzić w zbliżonym do produkcji środowisku.

Pełna automatyzacja deploymentu na produkcję (continuous deployment) może być etapem późniejszym. Na start wystarczy często continuous delivery: proces jest zautomatyzowany, ale produkcję zatwierdza człowiek, na podstawie wyników testów i metryk.

Diagnoza startowa monolitu i organizacji

Inwentaryzacja monolitu: moduły, granice funkcjonalne, przepływy

Migracja monolitu do mikroserwisów bez porządnej diagnozy kończy się zwykle „ciągnięciem kabli na ślepo”. Pierwszy krok to zrozumienie, jak naprawdę wygląda system, nie tylko na diagramach z Confluence sprzed kilku lat.

Praktyczna inwentaryzacja powinna objąć:

- Moduły logiczne – pakiety, warstwy, główne komponenty; co z czym się komunikuje.

- Kluczowe przepływy biznesowe – np. założenie konta, złożenie zamówienia, płatność, zwrot, fakturowanie.

- Punkty integracji – systemy zewnętrzne, legacy, partnerzy, płatności, raportowanie.

- Dane krytyczne – główne tabele, encje, obszary wymagające spójności transakcyjnej.

Dobrą, niskokosztową techniką jest zrobienie 2–3 krótkich warsztatów z deweloperami i analitykami, podczas których wspólnie rysuje się mapę przepływów i modułów, a następnie weryfikuje ją w kodzie i logach. Zespół od razu wskazuje „gorące punkty” – miejsca najbardziej złożone, niebezpieczne lub kluczowe dla biznesu.

Zależności zewnętrzne: bazy danych, legacy, integracje

Monolit zwykle ma jedną wspólną bazę danych i szereg integracji zewnętrznych. Przy migracji do mikroserwisów te zależności stają się newralgiczne. Lider IT powinien zebrać listę:

- baz danych (produkcyjnych i pomocniczych) – typ, wersja, kluczowe schematy,

- systemów legacy, z którymi monolit wymienia dane,

- interfejsów zewnętrznych – API partnerów, bramki płatnicze, systemy raportowania.

Techniczne długi i „ciemne strefy” systemu

Przy diagnozie monolitu powierzchowne wypisanie modułów to za mało. Trzeba jeszcze nazwać obszary, które realnie spowalniają rozwój i generują ryzyko. Dobrą praktyką jest sporządzenie krótkiej listy „top 10 problemów monolitu” z punktu widzenia:

- utrzymania – moduły, w których zmiana zawsze kończy się awarią na produkcji,

- rozwoju – funkcje, które ciągną za sobą modyfikacje w wielu miejscach naraz,

- wydajności – fragmenty kodu skutkujące skokowymi obciążeniami CPU/IO,

- bezpieczeństwa – wspólne moduły uwierzytelniania, uprawnień, dostępu do danych.

Nie trzeba od razu robić akademickiej oceny jakości kodu. Wystarczy krótki przegląd commitów, historii incydentów i feedbacku od zespołu, żeby zobaczyć, gdzie monolit realnie „boli”. Ta lista będzie później jednym z filtrów przy wyborze, które fragmenty systemu przenosić do mikroserwisów jako pierwsze.

Diagnoza organizacyjna: zespoły, procesy, kompetencje

Mikroserwisy nie zadziałają w organizacji, która funkcjonuje jak klasyczny „fabryczny” model IT: analitycy oddzielnie, deweloperzy oddzielnie, osobne zespoły od testów i infrastruktury. Trzeba spojrzeć szczerze na:

- strukturę zespołów – czy istnieją zespoły odpowiedzialne za konkretne domeny, czy raczej „frontend team”, „backend team”, „DBA” i „DevOps” bez jasnych obszarów biznesowych,

- proces wytwórczy – jak długo trwa droga od pomysłu do produkcji, ile jest przekazań między rolami,

- kompetencje CI/CD – kto realnie umie pisać pipeline’y, automatyzować infrastrukturę, diagnozować problemy w produkcji.

Z perspektywy lidera kluczowe jest określenie realnej pojemności zespołu na zmianę. Jeśli obecny backlog utrzymaniowy wysyca większość czasu, migracja „przy okazji” nie ruszy. W takiej sytuacji lepszym ruchem bywa oficjalne wydzielenie małego zespołu migracyjnego na część etatu z bardzo wąskim, dobrze zdefiniowanym celem.

Miary startowe: gdzie jesteśmy, zanim cokolwiek ruszymy

Bez prostych metryk startowych trudno później udowodnić, że migracja przynosi korzyści. Nie trzeba od razu wdrażać pełnego DORA Metrics. Na początek wystarczą 3–4 wskaźniki:

- czas od merge do produkcji – średni i maksymalny,

- częstotliwość wdrożeń – ile releasów miesięcznie,

- liczba krytycznych incydentów – przynajmniej w ujęciu kwartalnym,

- czas przywrócenia po awarii – jak długo trwa powrót do działania.

Te liczby nie muszą być superdokładne. Chodzi o rząd wielkości i wspólny punkt odniesienia. Po kilku iteracjach migracji można wrócić do tych samych wskaźników i sprawdzić, czy coś faktycznie się poprawia, czy tylko dokładamy sobie roboty.

Strategia migracji: big bang kontra podejście iteracyjne

Dlaczego big bang prawie nigdy się opłaca

„Przepiszmy wszystko” brzmi atrakcyjnie dla zmęczonych zespołów, ale z punktu widzenia ryzyka i kosztu to najdroższa opcja. Big bang oznacza:

- długi okres bez namacalnych efektów biznesowych,

- podwójne utrzymanie – starego monolitu i nowej platformy,

- olbrzymie ryzyko przy przełączeniu – jedna duża produkcyjna migracja.

W praktyce wiele takich projektów kończy zablokowaniem – biznes nie wytrzymuje kilku kwartałów bez nowych funkcji, a zespół jest rozdarty między „starą” i „nową” drogą. Finansowo to też pułapka: rosną koszty, a przychód nie rośnie, bo funkcje biznesowe stoją w miejscu.

Iteracyjna migracja: wyciąganie domen krok po kroku

Bardziej pragmatyczne jest podejście, w którym co 2–3 miesiące następuje zauważalna zmiana – wyciągnięcie kolejnej domeny do mikroserwisu, odciążenie monolitu w wybranym obszarze, ulepszenie pipeline’ów CI/CD. Iteracyjne podejście zwykle zakłada:

- wybór 1–2 domen na start jako „pilotaż”,

- zbudowanie podstawowego CI/CD tylko dla nich,

- stopniowe dokładanie kolejnych serwisów już na gotowym fundamencie.

Ryzyko rozkłada się w czasie, a zespół uczy się na konkretnych błędach. Każdy kolejny serwis jest odrobinę tańszy w wytworzeniu, bo korzysta z doświadczeń poprzedniego.

Kryteria wyboru pierwszych fragmentów do migracji

Najczęstszy błąd to zaczynanie od najtrudniejszej, najbardziej krytycznej domeny (np. płatności, fakturowanie). Lepszy kompromis to wybór fragmentu, który jest:

- ważny, ale nie krytyczny – awaria jest bolesna, ale nie zatrzymuje całego biznesu,

- w miarę dobrze zrozumiany – domena nie zmienia się co tydzień, istnieje sensowna dokumentacja lub „ekspert domenowy” na pokładzie,

- technicznie ograniczony – stosunkowo niewiele zależności z resztą monolitu i bazy.

Przykładowo w e-commerce często dobrym kandydatem jest katalog produktów albo moduł rabatów, a nie pełny proces zamówienia od koszyka po fakturę. Pozwala to zbudować pipeline’y, monitoring i nawyki deployowe na mniejszym ryzyku.

Planowanie przełączeń: anti-corruption layer i „strangler pattern”

Migracja rzadko polega na natychmiastowym wycięciu modułu z monolitu. Bardziej realny scenariusz to okres, w którym monolit i mikroserwis współistnieją. Do spięcia tego potrzebne są wzorce typu:

- anti-corruption layer – cienka warstwa tłumacząca stare modele danych i API monolitu na nowy model mikroserwisu; zespół unika „ciągnięcia” legacy do nowego świata,

- strangler pattern – stopniowe „oplatanie” monolitu nową logiką; ruch jest przekierowywany do mikroserwisu tylko dla wybranych scenariuszy lub klientów, aż w końcu stary kod można wyłączyć.

Te techniki wydłużają trochę czas migracji danego fragmentu, ale znacznie zmniejszają ryzyko biznesowe. Finansowo to bardziej opłacalne niż kilka weekendów „big switchover” z całym IT na dyżurach.

Rozbijanie monolitu na domeny i mikroserwisy

Modelowanie domen: event storming i mapy kontekstów

Zanim powstanie pierwszy mikroserwis, trzeba z grubsza rozumieć, gdzie przebiegają granice domen biznesowych. Do tego przydatne są lekkie techniki z Domain-Driven Design, ale użyte w wersji „budżetowej”:

- krótki warsztat event storming – wspólne rozrysowanie zdarzeń biznesowych („zamówienie złożone”, „płatność odrzucona”) i tego, które zespoły/systemy je obsługują,

- mapa kontekstów – prosta tabelka lub diagram pokazujący, które funkcje biznesowe są ze sobą silnie powiązane, a które mogą żyć osobno.

Nie chodzi o idealny model domeny na lata, lecz o w miarę sensowne grupy funkcji, które można przekształcić w serwisy z czytelną odpowiedzialnością. Błędy będą – dlatego lepiej mieć mniej serwisów o trochę za szerokiej domenie niż dziesiątki zbyt małych.

Jak nie projektować mikroserwisów

Najdroższym w utrzymaniu rozwiązaniem jest przenoszenie warstw technicznych jako osobnych serwisów (np. „serwis walidacji”, „serwis autoryzacji”, „serwis PDF”). Taka siatka drobnych usług wymusza ciągłe wywołania sieciowe i komplikuje diagnostykę.

Lepiej grupować odpowiedzialności wokół konkretnych obszarów biznesowych, np. „zamówienia”, „płatności”, „konta klientów”. Wtedy zmiana logiki biznesowej najczęściej dotyczy jednego serwisu i jednego zespołu, co bezpośrednio skraca czas dostarczania.

Wspólna baza vs. niezależne dane

Jednym z trudniejszych momentów jest odejście od wspólnej bazy monolitu. Jest kilka etapów przejściowych, które ograniczają koszt:

- read-only z monolitu – nowy mikroserwis na start tylko czyta dane ze wspólnej bazy, zapis nadal wykonuje monolit,

- wydzielenie schematu – wybrane tabele są „przenoszone logicznie” do osobnego schematu lub bazy, do której mikroserwis ma pełne prawa, a monolit korzysta przez API,

- pełna niezależność – serwis posiada własną bazę danych, inne systemy widzą tylko jego API albo mechanizm wymiany zdarzeń.

Dla lidera ważne jest, by z góry przyjąć prostą zasadę: każdy nowy mikroserwis ma własne repozytorium danych (nawet jeśli fizycznie na starcie siedzi w tym samym klastrze DB). Wspólne tabele między serwisami generują ukryte koszty i konflikty przy zmianach schematu.

Kontrakty między serwisami: API i zdarzenia

Im wcześniej pojawią się jasne kontrakty między usługami, tym mniej „twardych” zależności powstanie. Do budowy kontraktów można użyć prostych, tanich technik:

- kontraktowe testy API (np. OpenAPI + testy konsumenta),

- opis zdarzeń domenowych (format payloadu, reguły retencji, gwarancje dostarczenia),

- prosty katalog usług – chociażby w repozytorium dokumentacji, z listą endpointów i odpowiedzialnych zespołów.

Nie trzeba od razu stawiać rozbudowanego portalu „service catalog” z integracją we wszystkie strony. Na początek wystarczy wspólne repozytorium z plikami OpenAPI i opisem tematów zdarzeń.

Budowa fundamentów CI/CD przed pierwszym mikroserwisem

Infrastruktura na start: minimum, które nie spali budżetu

Zamiast budować od razu pełnoprawną platformę z autoskalowaniem, service mesh i zaawansowanym obserwowalnością, lepiej zacząć od prostego, ale powtarzalnego setupu:

- repozytoria kodu w jednym systemie (GitLab, GitHub, Bitbucket),

- wspólny rejestr artefaktów – np. Docker Registry albo built-in registry w używanym systemie CI,

- 2–3 środowiska – test, staging, produkcja; resztę (np. środowiska tymczasowe) można dobudować, gdy zespół nabierze wprawy.

Hosting można oprzeć zarówno o proste VM z Dockerem, jak i managed containers od dostawcy chmury. Kryterium powinno być jedno: czy zespół jest w stanie samodzielnie utrzymywać rozwiązanie, czy będzie musiał wzywać zewnętrznych konsultantów do każdej drobnej zmiany.

Standard projektowy: szablony repozytoriów i pipeline’ów

Żeby każdy mikroserwis nie był „rękodziełem”, przydaje się prosty szablon projektu, obejmujący:

- podstawową strukturę katalogów,

- domyślny Dockerfile,

- pliki konfiguracji pipeline’u CI/CD,

- szkielet testów (nawet jeśli na początku będzie to kilka testów jednostkowych).

Można zacząć od jednego referencyjnego repozytorium, które nowy serwis klonuje jako punkt wyjścia. To najtańsza forma standaryzacji. Z czasem da się ją przenieść do mechanizmów „template project” oferowanych przez większość systemów Git.

Bezpieczne zarządzanie konfiguracją i sekretami

W świecie mikroserwisów liczba zmiennych konfiguracyjnych i sekretów rośnie lawinowo. Jeśli od początku nie ma na to planu, skończy się na plikach .env przesyłanych mailem. Prosty, pragmatyczny zestaw zasad wygląda tak:

- konfiguracje niesekretne (feature flagi, limity, adresy usług) w repozytorium lub systemie typu ConfigMap,

- sekrety w centralnym, minimalnie zarządzanym narzędziu (np. Secret Manager w chmurze, Vault w wersji „core”),

- brak haseł i kluczy w repozytoriach – wymuszony np. przez skanery sekretów podpięte do CI.

Dla biznesu najważniejsze jest ryzyko wycieku danych i konsekwencje prawne. Dla zespołu – koszty sprzątania po takim incydencie. Uporządkowanie sekretów na starcie jest relatywnie tanie w porównaniu z reagowaniem po fakcie.

Monitoring i logowanie: wersja „light”

Pełne observability to spory inwestycyjny temat. Na początek wystarczy zestaw, który pozwoli znaleźć przyczynę większości problemów bez kilkugodzinnego grzebania:

- centralne logowanie (np. ELK/Opensearch lub managed log service),

- proste metryki aplikacyjne – liczba requestów, czas odpowiedzi, błędy 4xx/5xx,

Najczęściej zadawane pytania (FAQ)

Kiedy naprawdę opłaca się migrować monolit do mikroserwisów?

Migracja zaczyna mieć sens, gdy architektura wyraźnie blokuje rozwój biznesu. Typowe sygnały to: długie i nieprzewidywalne releasy, konieczność „okien serwisowych”, częste rollbacki, a także sytuacje, w których jeden mało istotny błąd zatrzymuje wdrożenie kluczowej funkcji.

Z biznesowego punktu widzenia dobrym powodem jest rosnąca presja na czas dostarczania i stabilność: konkurencja wdraża w tygodnie, a u ciebie w miesiące; koszty incydentów i przestojów rosną; trudno szybko reagować na zmiany regulacyjne lub nowe integracje. Jeśli tego typu problemy dominują, inwestycja w mikroserwisy i CI/CD ma szansę się zwrócić.

W jakich sytuacjach lepiej zostać przy monolicie i go nie ruszać?

Monolitu nie ma sensu naruszać, jeśli system jest stabilny, zakres zmian biznesowych jest umiarkowany, a zespół (np. 5–7 deweloperów) sprawnie współpracuje nad jednym kodem. Jeśli wdrożenia co 2–4 tygodnie są akceptowalne, a liczba awarii niewielka, migracja będzie głównie kosztem bez wyraźnej przewagi.

Rozsądniejszą ścieżką bywa wtedy: stopniowa refaktoryzacja, lepsza modularność monolitu i wdrożenie CI/CD dla jednego repozytorium. To znacznie tańszy sposób na skrócenie czasu dostarczania i poprawę jakości, bez ryzyka związanego z rozbijaniem systemu na wiele serwisów.

Jak ocenić opłacalność migracji monolitu do mikroserwisów?

Praktycznie robi się to przez porównanie trzech koszyków: obecnego kosztu utrzymania i wdrożeń, kosztu samej migracji oraz spodziewanych korzyści po zmianie. W pierwszym koszyku powinny znaleźć się m.in. czas ludzi na releasy, koszty incydentów, nadgodziny przy „nocnych oknach serwisowych” oraz opóźnienia projektów biznesowych.

Do kosztu migracji dochodzą etaty, szkolenia, nowe narzędzia, a także zwiększone ryzyko błędów w trakcie przejścia. Korzyści po migracji to przede wszystkim skrócenie lead time, możliwość niezależnych wdrożeń, lepsza skalowalność i mniejsza wrażliwość na pojedyncze awarie. Sensowny, „budżetowy” wariant zakłada, że część tych korzyści wyciągasz jeszcze przed pełną migracją – dzięki automatyzacji testów, CI/CD i porządkowaniu monolitu.

Jakie są główne techniczne i organizacyjne symptomy, że monolit zaczyna przeszkadzać?

Technicznie: releasy trwają tygodniami, potrzebne są okna serwisowe i częste rollbacki, a zmiana w jednym module zbyt często psuje inne obszary. Pojawia się też brak „selektywnej” skalowalności – skalujesz cały system, choć tylko kilka funkcji generuje ruch – oraz narastający dług technologiczny, przez który każdy sprint kończy się łataniem.

Organizacyjnie pojawiają się konflikty między zespołami dotykającymi tego samego kodu, blokady, kolejki do jednego repozytorium i trudność w równoległym rozwoju funkcji. Z perspektywy biznesu przekłada się to na wolną reakcję na rynek, rosnące koszty utrzymania i spadek satysfakcji klientów przez niestabilne wdrożenia.

Jak sprzedać migrację monolitu do mikroserwisów zarządowi?

Zarząd nie jest zainteresowany „mikroserwisami” jako technologią. Interesuje go krótszy czas wejścia na rynek, mniejsze ryzyko awarii w krytycznych momentach i bardziej przewidywalne koszty rozwoju. Argumenty techniczne trzeba przełożyć na konkretne efekty: tygodnie zamiast miesięcy od pomysłu do produkcji, mniej krytycznych incydentów, możliwość skalowania tylko dochodowych fragmentów systemu.

Pomaga etapowy plan zamiast hasła „przepiszmy wszystko”: pilotaż na jednym obszarze, z mierzalnym efektem (np. skrócenie czasu wdrożenia o X dni, spadek liczby incydentów po releasach). To obniża próg wejścia, a jednocześnie pozwala pokazać realną stopę zwrotu przed podjęciem decyzji o szerokiej transformacji.

Jaką rolę pełni CI/CD przy przejściu z monolitu na mikroserwisy?

CI/CD jest warunkiem, żeby mikroserwisy były w ogóle utrzymywalne. Każdy serwis potrzebuje powtarzalnego pipeline’u: budowania artefaktu po commicie, uruchamiania testów, pakowania aplikacji (np. w obraz kontenera) i automatycznego wdrożenia na kolejne środowiska. Przy kilkunastu serwisach ręczne klikanie releasów kończy się chaosem i rosnącymi kosztami operacyjnymi.

Z perspektywy lidera ważna jest standaryzacja: wspólne szablony pipeline’ów, spójne podejście do logowania, monitoringu i rollbacków. Ta inwestycja zwraca się szybciej niż sama migracja, bo pozwala skrócić cykl wdrożenia nawet wciąż pracując na monolicie.

Czy mikroserwisy faktycznie zmniejszają dług technologiczny i koszty?

Same w sobie – nie. Przeniesienie źle zaprojektowanego, zaciągniętego technicznie kodu do wielu repozytoriów tylko rozproszy problem. Mikroserwisy dają szansę na lepsze rozdzielenie odpowiedzialności, izolację awarii i niezależne tempo zmian, ale jakość kodu i procesów trzeba poprawić niezależnie od wybranej architektury.

Z punktu widzenia kosztów mikroserwisy mają narzut: więcej pipeline’ów CI/CD, więcej monitoringu, więcej elementów do utrzymania. Korzyści finansowe pojawiają się dopiero przy odpowiedniej skali – gdy wiele zespołów pracuje równolegle, a selektywna skalowalność i szybsze wdrożenia realnie wpływają na przychody i ryzyko biznesowe.

Źródła

- Building Microservices. O'Reilly Media (2015) – Praktyczne zasady projektowania i wdrażania architektury mikroserwisowej

- Monolith to Microservices. O'Reilly Media (2019) – Strategie migracji monolitu do mikroserwisów, wzorce i antywzorce

- Accelerate: The Science of Lean Software and DevOps. IT Revolution Press (2018) – Badania DORA: metryki DevOps, wpływ częstotliwości wdrożeń i lead time

- Microservices Patterns. Manning Publications (2019) – Wzorce mikroserwisów, dekompozycja domeny, niezależne wdrażanie i skalowanie